Re: [V4.5 IP4] Nutzung von KI (LLM) für Dokumentation und Custom-Logiken

Verfasst: Do Mai 14, 2026 9:14 pm

Hallo zusammen,

hier das erwähnte Update des MetaPro v2.8:

- "sauberes" Markdown-Format.

- keine eigenständigen Änderungen am Meta-Prompt mehr erlaubt. Das LLM erzeugt Textblöcke mit Änderungen/Ergänzungen und der User muss den MetaPrompt für den nächsten Chat manuell aktualisieren

- Während des Prozesses den Code nur als Snippets ausgeben (um Token zu sparen); Gesamtausgabe auf Anfrage/nach Bestätigung

- keine extra Zeilenumbrüche mehr

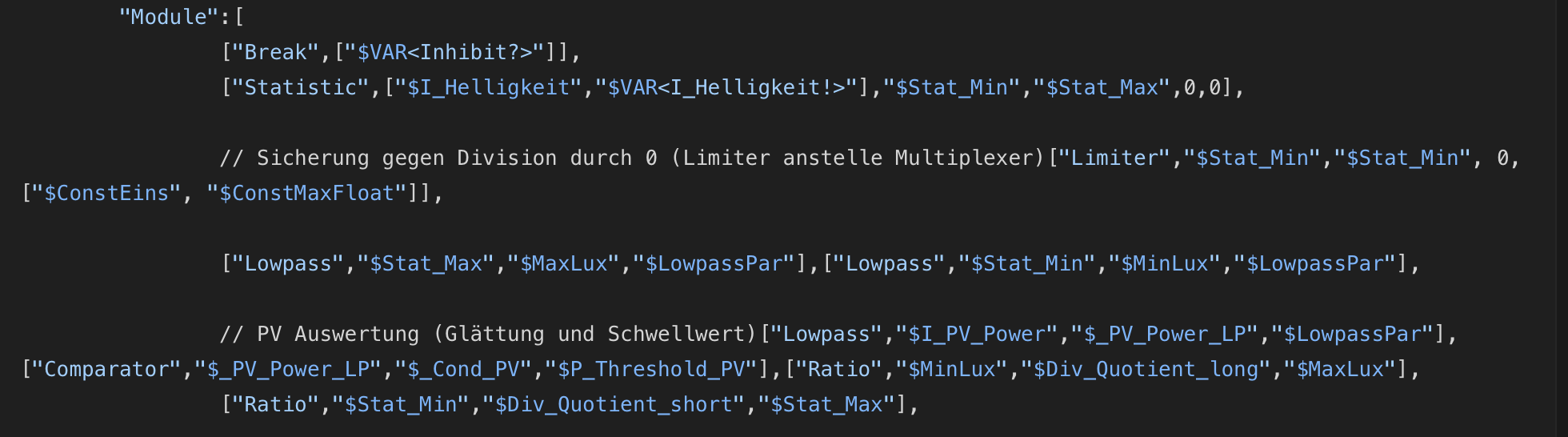

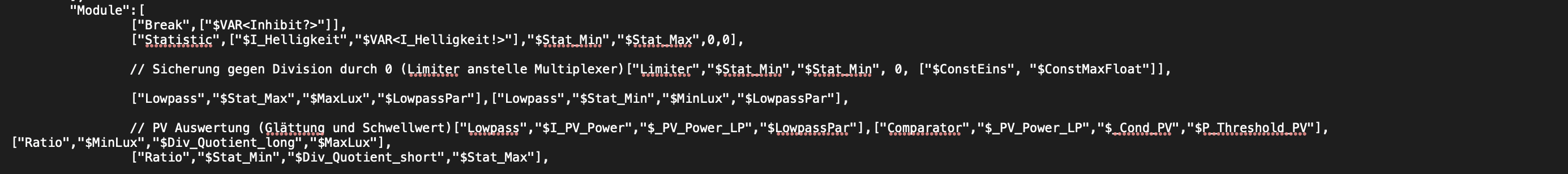

- keine Block-Kommentare (Start... Ende). Kommentare/Code mit Referenz auf die Anforderungen strukturieren.

- Konvention für Variablennamen explizit formuliert (intern: $_; $in_; $out_; $Const_; $Str)

Testen ist ... schwierig. Die Antworten und Ergebnisse sind nicht immer gleich und manchmal einfach nur anders. Ich verlasse mich vorerst aufs "Bauchgefühl" und Bewertungen des Meta-Prompts durch LLMs. Eine Test-Suite mit Standard-Aufgaben wäre sinnvoll, aber die müsste auch ein LLM bewerten und das Ganze kostet auch schnell eine Menge Token und/oder viel Zeit.

Ich schaue gerade mal mehr in Richtung Claude und auch get-shit-done hab ich mir mal auf die "Ausprobieren" Liste gesetzt.

VG

Stefan

hier das erwähnte Update des MetaPro v2.8:

- "sauberes" Markdown-Format.

- keine eigenständigen Änderungen am Meta-Prompt mehr erlaubt. Das LLM erzeugt Textblöcke mit Änderungen/Ergänzungen und der User muss den MetaPrompt für den nächsten Chat manuell aktualisieren

- Während des Prozesses den Code nur als Snippets ausgeben (um Token zu sparen); Gesamtausgabe auf Anfrage/nach Bestätigung

- keine extra Zeilenumbrüche mehr

- keine Block-Kommentare (Start... Ende). Kommentare/Code mit Referenz auf die Anforderungen strukturieren.

- Konvention für Variablennamen explizit formuliert (intern: $_; $in_; $out_; $Const_; $Str)

Testen ist ... schwierig. Die Antworten und Ergebnisse sind nicht immer gleich und manchmal einfach nur anders. Ich verlasse mich vorerst aufs "Bauchgefühl" und Bewertungen des Meta-Prompts durch LLMs. Eine Test-Suite mit Standard-Aufgaben wäre sinnvoll, aber die müsste auch ein LLM bewerten und das Ganze kostet auch schnell eine Menge Token und/oder viel Zeit.

Ich schaue gerade mal mehr in Richtung Claude und auch get-shit-done hab ich mir mal auf die "Ausprobieren" Liste gesetzt.

VG

Stefan